L’IA est-elle la meilleure amie d’une fille ? Une analyse sexospécifique des défis juridiques et éthiques des systèmes d’IA

N’oubliez jamais qu’il suffira d’une crise politique, économique ou religieuse pour que les droits des femmes soient remis en question. Ces droits ne sont jamais acquis. Vous devrez rester vigilantes votre vie durant. ~ Simone de Beauvoir

Cet avertissement de Simone de Beauvoir est toujours d’actualité après tant d’années passées entre les livres sur le Second Sexe et l’ère de l’IA et des pandémies. Oui, l’indice global des disparités entre les sexes continue de s’améliorer selon les rapports du Forum économique mondial, mais notre époque pose de nouveaux défis qui lui sont propres, sans parler des vieux fantômes du passé qui traînent encore. C’est particulièrement évident dans le contexte de la pandémie COVID-19, où nous avons assisté, en l’espace d’une petite année, à une forte augmentation de la violence contre les filles et les femmes, ainsi qu’à son coût économique.

Mais revenons un peu en arrière. Les technologies de l’intelligence artificielle ont été au centre de l’attention des décideurs politiques au niveau national et international pendant un certain temps. En 2019, la nomination de la nouvelle présidente de la Commission européenne, Ursula von der Leyen, est devenue mémorable à double titre. D’une part, elle a été la première femme à occuper ce poste qui a permis de briser une autre couche du plafond de verre, mais elle a également mis un accent remarquable sur les technologies numériques, l’IA en particulier, et leurs pouvoirs de transformation sur la société européenne. Elle est même allée plus loin en promettant une « approche européenne coordonnée des implications humaines et éthiques de l’intelligence artificielle » au cours de ses 100 premiers jours de travail. Cette promesse a été plus ou moins concrétisée par le livre blanc sur l’intelligence artificielle au début de l’année 2020, qui a suscité des réactions mitigées de la part des différentes parties prenantes. Il est important de dire que le Livre blanc fait partie d’objectifs politiques plus larges et doit être considéré avec d’autres documents politiques tels que la stratégie des données, la stratégie industrielle pour l’Europe, etc. Nous pouvons aller jusqu’à identifier l’AI, son utilisation et sa réglementation, comme un point focal autour duquel s’articulent les autres actions politiques de la Commission. Même dans la stratégie européenne pour l’égalité des sexes 2020-2025, nous considérons le lien entre le développement et le déploiement de l’AI et l’égalité des sexes comme un « moteur essentiel du progrès économique ». Ce qui est remarquable, cependant, c’est la double nature de l’AI en ce qui concerne les droits de l’homme, et en particulier les droits des femmes.

Ce fait est reconnu dans la stratégie pour l’égalité entre les sexes elle-même, mais il est déjà assez évident dans la pratique aussi. Nous nous battons depuis des années contre la sous-représentation des femmes dans le secteur technologique. Bien qu’il y ait une certaine amélioration, les chiffres sont loin d’être impressionnants. Toutefois, lorsque nous parlons des femmes dans le secteur technologique, nous devons nous rappeler qu’il s’agit d’un domaine très vaste et que, si les femmes sont sous-représentées en général, elles le sont encore plus lorsque nous parlons de la participation des femmes au développement des technologies d’IA. Le rapport mondial sur l’écart entre les sexes pour 2020 indique que les femmes représentent environ 26 % des travailleurs dans le domaine des données et de l’IA. Plus inquiétantes encore sont les données montrant que les femmes chercheurs ne représentent que 12 % des chercheurs en IA dans le monde.

Qu’est-ce que cela signifie ? Pour citer Meredith Broussard, décrivant l’histoire (et l’état actuel) désastreuse de l’IA : « …nous avons un petit groupe d’hommes d’élite qui ont tendance à surestimer leurs capacités mathématiques, qui ont systématiquement exclu les femmes et les personnes de couleur en faveur des machines pendant des siècles,…qui ont des piles inutilisées d’argent du gouvernement qui traînent, et qui ont adopté la rhétorique idéologique des anarcho-capitalistes libertaires d’extrême droite. Qu’est-ce qui pourrait mal tourner ? Eh bien, en fait, pas mal de choses.

Tout d’abord, il est important de souligner qu’il existe de nombreuses façons dont l’IA peut affecter les femmes de manière négative. Les problèmes sont généralement liés à la discrimination, mais ils peuvent très bien avoir des conséquences encore plus graves, comme l’atteinte à leur droit à la santé. Un modèle d’IA est aussi bon que les données qu’il contient et s’il y a un biais dans les données, cela affectera le modèle. Par exemple, un ensemble de données biaisées qui ne tient pas compte des symptômes des maladies cardiaques chez les femmes, car les hommes sont statistiquement plus susceptibles de souffrir de telles affections, aboutira à un système d’IA censé aider les professionnels de la santé et les patients à poser un diagnostic, ne reconnaissant pas suffisamment les affections cardiaques chez les femmes et mettant ainsi leur vie en danger.

Même si les données ne sont pas le problème, il est possible que le modèle d’IA discrimine les femmes sur la base d’attributs protégés qui ont délibérément été supprimés des données principales, mais qui ont néanmoins joué un rôle dans le résultat discriminatoire. Pour donner un exemple, le sexe, en tant qu’attribut protégé, pourrait ne pas être inclus dans l’ensemble des données de formation pour un système d’évaluation des CV AI pour les emplois de développement de logiciels. Pourtant, le modèle pourrait déterminer que les hommes sont préférés sur la base d’un nombre historique plus important de CV et déclasser les CV contenant le mot « femme », par exemple dans le nom de l’établissement d’enseignement dont un candidat provient. En d’autres termes, vous n’apprenez pas à votre IA ce qu’est le « genre » et si cela est important, mais elle détermine qu’elle le fait en fonction du meilleur taux de réussite des candidats masculins. C’est un cas réel chez Amazon qui a utilisé ce type d’outil de recrutement d’IA .

D’un point de vue juridique, un autre problème apparaît lorsqu’une victime de discrimination décide de protéger ses droits et de demander réparation. Les concepts juridiques traditionnels de responsabilité et d’obligation de rendre compte ne sont pas toujours suffisamment souples pour offrir aux victimes une solution satisfaisante, car il est de plus en plus difficile de déterminer qui est responsable et, donc, redevable de la discrimination lorsque celui qui discrimine est un système d’IA. En effet, il pourrait même s’agir d’un simple produit acheté par une entreprise qui n’a jamais participé à l’élaboration du système.

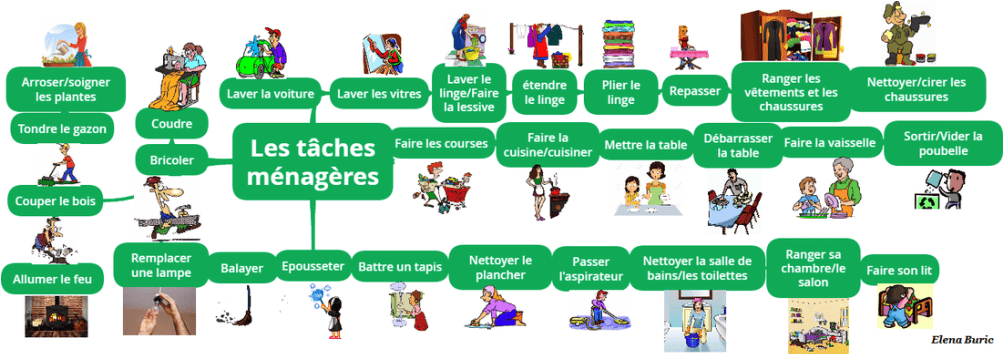

Sommes-nous foutus alors ? Pas nécessairement. L’IA ne crée pas pour les femmes des problèmes qui n’existaient pas auparavant ; elle ne fait que refléter et amplifier les stéréotypes et les défauts de notre société à l’égard des femmes. Pourquoi les assistantes numériques féminines comme Siri ou Alexa répondaient-elles au harcèlement sexuel par des phrases telles que « je rougirais si je le pouvais » ? Pour moi et pour toutes les autres femmes, la réponse est claire, et le problème n’est pas l’IA. Après tout, il ne s’agit en fin de compte que d’un tas de 1 et de 0.

Nous allons utiliser l’IA à notre avantage. Ses avantages sont trop importants pour être négligés en raison des problèmes que nous pouvons résoudre. La surveillance des systèmes d’IA à haut risque, la certification et la fiabilité par conception ne sont que quelques-unes des solutions. Il existe des boîtes à outils conçues pour tester les systèmes et résoudre les problèmes avant qu’ils ne se posent dans le monde réel. Si l’on met de côté les mesures techniques, il existe de nombreuses mesures organisationnelles que nous pouvons adopter pour améliorer la situation. La priorité numéro un est d’impliquer davantage de femmes dans la recherche et le développement de l’IA. Le mentorat, le soutien et l’augmentation de la visibilité des femmes qui sont déjà sur le terrain sont essentiels, mais nous devrions également investir dans les jeunes filles et briser la stigmatisation dans l’éducation. Enfin, nous devons reconnaître la diversité des femmes en tant que groupe et investir davantage d’efforts là où ils sont nécessaires. Un bon exemple est celui des femmes de couleur, qui sont souvent victimes d’un double préjugé. On dit qu’AI est là pour transformer l’avenir, et nous avons le pouvoir de faire en sorte que cet avenir soit celui que nous voulons pour nous-mêmes – égal et plein de possibilités.

Katerina Yordanova, chercheuse en droit à la KU Leuven, Centre for IT and IP Law (CITIP).

Les opinions exprimées dans ce document sont uniquement celles de l’auteur.

FOLLOW US

Katerina Yordanova

Researcher in law at KU Leuven, Centre for IT and IP Law (CITIP)

Commentaires récents